全球电子设计与验证领域的重要国际会议——DVCon China 2026圆满举行。大会现场,芯华章首席科学家徐强教授受邀发表题为《从生成到信任:芯片验证智能体的证据闭环》的主旨演讲。这是徐强教授加入芯华章后的首次公开亮相。

他在演讲中提出,AI Agent进入芯片验证流程的关键,不在于能够生成多少RTL片段、测试用例、断言或调试假设,而在于能否将这些生成物转化为可证明、可核验、可追溯、可治理的签核级证据。

随着生成式AI与智能体技术加速进入芯片研发流程,EDA行业正在从工具自动化迈向智能协同。

然而,在芯片验证这一高可靠性工程场景中,生成能力并不等于可信能力。一个看似合理但未经验证的输出,可能带来错误假设、误导性覆盖率判断,甚至隐藏真实设计缺陷。

因此,如何让AI的“生成力”真正转化为验证流程可接受的“可信生产力”,成为AI Agent在EDA领域落地的核心问题。

徐强教授在演讲中指出:“AI Agent真正进入芯片验证流程,关键不在于它能生成多少内容,而在于能否把生成物转化为可审查、可复现、可追溯、可治理的工程证据。模型不是事实源,证据才是。”

填补AI概率性与验证确定性之间的鸿沟

芯片验证与一般AI应用有着本质差异。徐强教授强调,大语言模型本质上具有概率性、上下文敏感性和不确定性,而硬件验证要求确定性、可重复性、语义精确性和证据支撑。

这一矛盾决定了,验证智能体不能只是一个会生成内容的模型接口,而必须成为能够连接验证意图、EDA引擎、证据库和治理机制的工程系统。

因此,下一代验证智能体必须回答两个关键问题:

1.如何将AI的概率性输出,转化为验证签核所需的确定性证据?

2.如何将不可控的自主生成,纳入可治理、可审计、可复核的工程流程?

在徐强教授看来,验证的本质不是生成更多内容,而是完成信任闭环。AI Agent的价值,不在于替代验证工程师做判断,而在于帮助工程师更高效地构建、检查和管理证据。

构建可信验证智能体的“三大支柱”

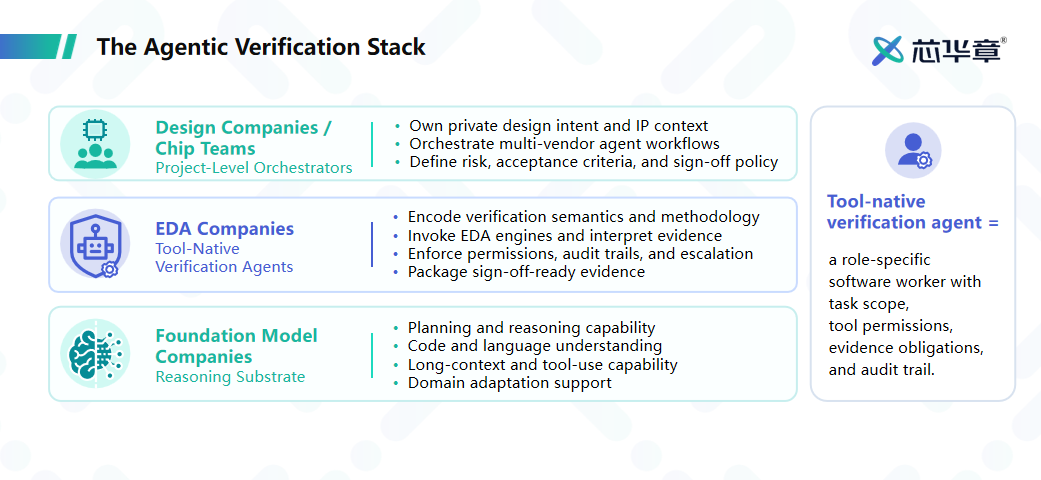

围绕“从生成到信任”的核心命题,芯华章提出构建可信验证智能体的三大支柱:验证语义映射、EDA引擎证据驱动推理,以及可治理控制平面。

支柱一:验证语义映射——让智能体知道“要验证什么”

验证需求往往来自规格文档、验证计划、RTL 结构、接口协议和项目方法论,并非天然就是清晰、完整、可执行的形式化描述。

芯华章通过构建验证意图模型,将自然语言需求转化为结构化的验证目标,并与信号、事务、场景、断言、覆盖率目标及所需证据建立关联。

徐强教授强调,智能体提出的语义映射首先是“候选假设”,并不等同于事实。只有经过EDA工具验证或工程师确认,相关映射才能进入可信流程。

以一个简单的valid-ready握手需求为例,“valid 必须保持有效,直到 ready 出现”看似直观,但真正落地到验证任务时,智能体仍需确认对应信号、接口范围、复位条件、时序假设、协议语义以及所需证据。这不是简单的文本翻译,而是从模糊需求到结构化验证任务的语义映射过程。

支柱二:EDA引擎证据驱动推理——让工具为结论背书

在验证场景中,不能只问模型“你觉得对不对”,而要问工具“证据是否支持”。智能体提出的断言、约束、覆盖率解释或调试假设,都必须经过EDA引擎校验,才能成为可信结论的一部分。

在该机制下,智能体不再仅凭语言模型给出判断,而是调用仿真、形式验证、调试、回归等EDA引擎进行验证,并将编译结果、波形、覆盖率、证明结果、假设条件及人工审批记录沉淀到证据库(Evidence Store)中,使关键生成物具备可追溯、可复核的证据来源。

徐强教授表示:“没有验证语义,就没有有用的智能;没有EDA引擎证据,就没有信任;没有治理机制,就没有可接受的自治。”

支柱三:可治理控制平面——让智能体在边界内自主

随着AI Agent开始参与真实验证流程,仅有生成能力和工具调用能力仍然不够。智能体必须清楚知道哪些动作可以自动执行,哪些动作需要审批,哪些动作必须记录,哪些动作不能由系统静默完成。

芯华章认为,治理不是一句提示词(Prompt),而是一套控制平面(Control Plane)。例如,智能体可以在权限范围内自动生成断言、调用仿真或读取覆盖率报告;但若涉及修改验证需求、调整关键假设、豁免失败断言或影响签核状态,则必须触发审批、记录和审计流程。

通过策略管理、权限控制、风险分类、人工审批、审计追踪和证据留存,验证智能体可以在保持自主性的同时,始终运行在清晰的工程边界内。换言之,智能体需要自由度来帮助工程师,也需要边界来赢得信任。

EDA原生能力是可信验证智能体落地关键与核心壁垒

徐强教授指出,AI Agent要真正进入验证签核流程,不能脱离EDA引擎、验证方法论和工程师判断。通用大模型可以提供推理、生成和规划能力,但工业级验证智能体还需要将模型能力与仿真、形式验证、调试、覆盖率、回归基础设施及签核流程深度结合。

具备底层EDA引擎、验证方法论积累和工程实践经验的EDA公司,将成为可信验证智能体落地的重要承载方。芯华章在数字验证领域长期积累的仿真、形式验证、硬件加速、调试和验证管理能力,为构建以证据闭环为核心的验证智能体提供了重要基础。

在这一体系中,AI Agent并不是外接在验证流程之外的聊天助手,而是与真实验证工作流深度连接:理解验证意图,调用EDA引擎,解释工具结果,沉淀证据记录,并在治理机制下与工程师协同完成验证闭环。

这种“EDA原生引擎 + 验证方法论 + 智能体协同 + 证据治理”的能力组合,共同构成可信验证智能体的专业壁垒。

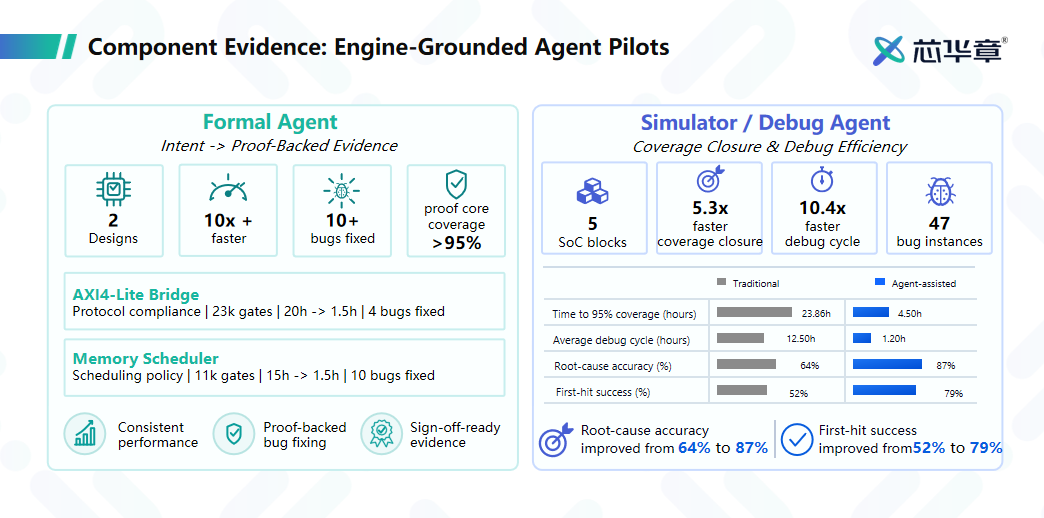

早期内部pilot显示工程落地潜力

围绕可信验证智能体的技术路径,芯华章已在部分内部组件级pilot中开展探索。

早期结果显示,在工具证据闭环与工程师复核机制下,Formal Agent、Simulator/Debug Agent已在协议合规、调度策略、覆盖率收敛和故障定位等任务中展现出显著效率提升:

Formal Agent

在AXI4-Lite Bridge协议合规、Memory Scheduler调度策略等任务上,实现超过10倍效率提升,并达到95%以上的证明核心覆盖率(Proof Core Coverage);

Simulator/Debug Agent

在多个SoC模块和缺陷实例中展现出覆盖率收敛与调试效率提升。

芯华章表示,这些结果并非完整自治或通用基准,而是表明:以EDA引擎为依据、以证据为闭环、以人为治理节点的智能体路线,具备走向工程落地的潜力。

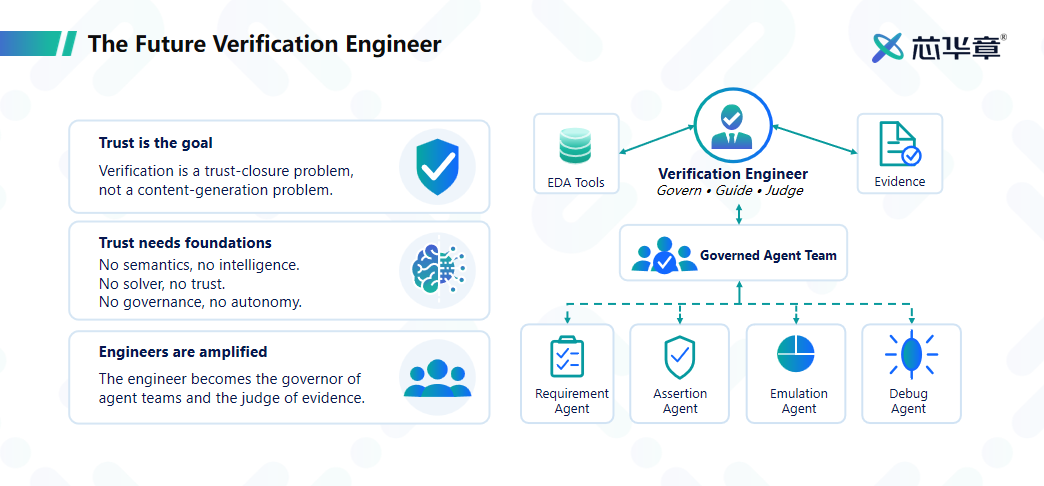

徐强教授在演讲中强调,可信验证智能体的目标不是让AI绕过工程师,而是让工程师拥有更强的判断工具、更完整的证据链和更高效的验证闭环。

验证工程师不会被替代,而会被进一步放大

面对AI Agent带来的工作流变化,徐强教授认为,验证工程师的角色不会被削弱,反而会变得更加重要。

随着智能体承担更多生成、执行和分析任务,工程师将更加聚焦于验证意图定义、风险判断、边界治理和最终证据审定。

他表示:“AI时代的验证工程师不会被替代,而会被放大。未来工程师将成为智能体团队的治理者、验证意图的引导者和证据质量的裁决者。”

在这一新模式下,验证工程师将从繁重的手工执行中逐步释放出来,转向更高价值的工程判断:定义目标、设定边界、审查证据、管理风险,并最终对签核质量负责。

AI Agent则作为一组可治理、可审计、可复核的“数字化验证助手”,协同工程师完成更复杂、更长期、更高覆盖度的验证任务。

这一理念与芯华章EDA 2.0愿景高度契合。面向更复杂的芯片研发挑战,芯华章将持续推进开放标准化、自动化智能化、平台化服务化的技术路径,将AI Agent、EDA原生引擎和证据闭环机制深度融合,推动验证流程从工具驱动走向证据驱动,从局部自动化走向可信智能协同。

芯华章将深耕可信验证智能,帮助芯片企业在提升研发效率的同时,守住验证质量、工程可控性和签核可信度。