谷歌宣布其"TurboQuant"技术后,这一能显著减少内存半导体使用量的创新引发了包括三大内存制造商在内的半导体企业股价剧烈波动,先是大跌后又反弹。但专家预测,三大内存制造商的股价仍有充足增长空间,因为TurboQuant的出现实际上可能会在长期内提振半导体需求。

近日,谷歌在其研究博客上发表了题为"TurboQuant: Redefining AI Efficiency with Extreme Compression"的论文。TurboQuant是一项通过解决大型语言模型(LLM)推理过程中出现的内存瓶颈,提高人工智能(AI)内存效率的技术。

目前,ChatGPT 和 Gemini 等人工智能技术正从基于训练的模型向基于推理的模型演进。为了推理和生成回应,上下文数据(如与用户的对话和搜索结果)被存储在一个名为"KV缓存"的临时仓库中。随着对话的积累,KV缓存占用的内存也相应增加。

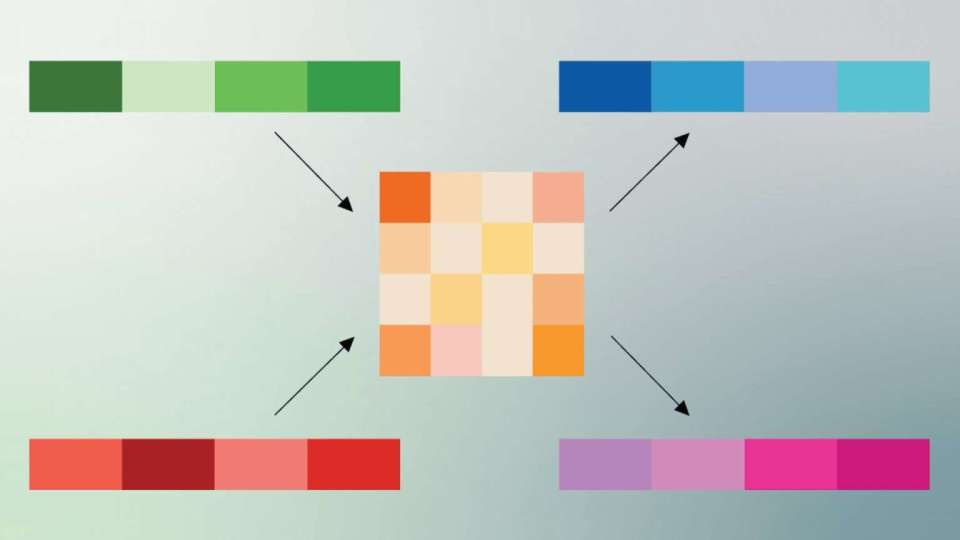

在这种情况下,从临时存储中检索数据时会出现瓶颈。TurboQuant技术通过将内存大小减少六倍同时保持数据准确性,从而减轻内存负担。谷歌计划于4月23日至27日在巴西举行的国际AI学术会议"ICLR 2026"上正式展示与TurboQuant相关的详细研究成果。

参与TurboQuant核心算法开发的KAIST电气工程学院的韩仁洙教授在3月30日的线上研究报告会上表示:"这是软件影响硬件市场的一个例子,"并补充道,"TurboQuant技术最大的优势在于它适用于任何AI模型。"因此,随着TurboQuant技术商业化,市场预期包括存储KV缓存的高带宽内存(HBM)在内的半导体需求将减少,导致半导体股价大跌。

然而,半导体行业和专家们普遍认为,这种急剧下跌是市场的误解。他们认为,所谓的"杰文斯悖论"在此适用,即技术效率提高会导致资源成本降低,从而使整体使用量爆炸性增加。

汉阳大学电子工程系的朴载根特聘教授在电话采访中解释道:"如果推理内存效率提高,更多人将投入推理AI开发,半导体需求也会随之增长。"同时,摩根士丹利分析师Sean Kim也在3月26日向彭博社预测:"如果TurboQuant能在不降低性能的情况下降低内存需求,成本将显著降低,增加AI应用的盈利能力,"他补充道,"较低的成本也将增加产品采用需求,从长远来看有利于内存制造商。"

最近,谷歌通过其博客披露的研究结果重新引起了人们对该研究团队去年4月发表的一篇论文的关注。

HSL Partners首席执行官、半导体投资专家李亨洙在电话采访中表示:"由于TurboQuant技术在一年前就已作为论文发表,可以理解为市场创造了一个获利了结的基础,"他补充道,"即使在未来KV缓存将激增的情况下(如Agent AI和Physical AI)可以实现1/6的压缩,额外的半导体需求仍然有保障。"

韩亚证券研究员金永健在3月30日的报告中指出:"这次股价调整是在宏观经济不确定性中满足部分获利需求的机会,"并且"考虑到英伟达也提交了类似方向的论文,这种反应更多是时机问题而非内容问题。"

TurboQuant引发的市场大跌可与去年1月的"DeepSeek冲击"相提并论。当时,中国出现基于较低规格芯片构建的DeepSeek,对AI相关股票造成重大影响,英伟达在单日内下跌约17%。然而,在两周内,英伟达股价恢复到DeepSeek出现前的水平,并继续创下新高。

KB证券研究员金东元在3月27日的报告中解释:"TurboQuant和DeepSeek作为实现低成本、高效率AI的软件优化技术都很重要,但考虑到未来五年AI数据中心投资扩张的预期步伐,仅靠这些技术满足激增的AI需求存在实际限制。"

尽管三大内存制造商的股价大跌,但证券业界仍维持目标股价,反映了全球内存繁荣预期。KB证券研究员金东元解释道:"类似于1860年代蒸汽机效率提高后煤炭需求实际增加,以及1900年代互联网引入后纸张使用量激增的情况,预计效率提高实际上会扩大需求的'反弹效应'将会发生。"